Los sistemas de comunicación convergente se usan en mando de emergencia, seguridad pública, rescate contra incendios, despacho industrial, transporte y grandes proyectos de seguridad. Un operador puede coordinar voz, radio, video, alarmas y recursos de campo desde una sola plataforma.

Pero muchos proyectos encuentran un problema oculto: la compatibilidad de video es más difícil de lo esperado. El reto real no es solo conectar una cámara a la red, sino resolver codificación, protocolos, capacidad de decodificación, soporte del navegador y rendimiento en tiempo real.

La brecha oculta en los proyectos de despacho unificado

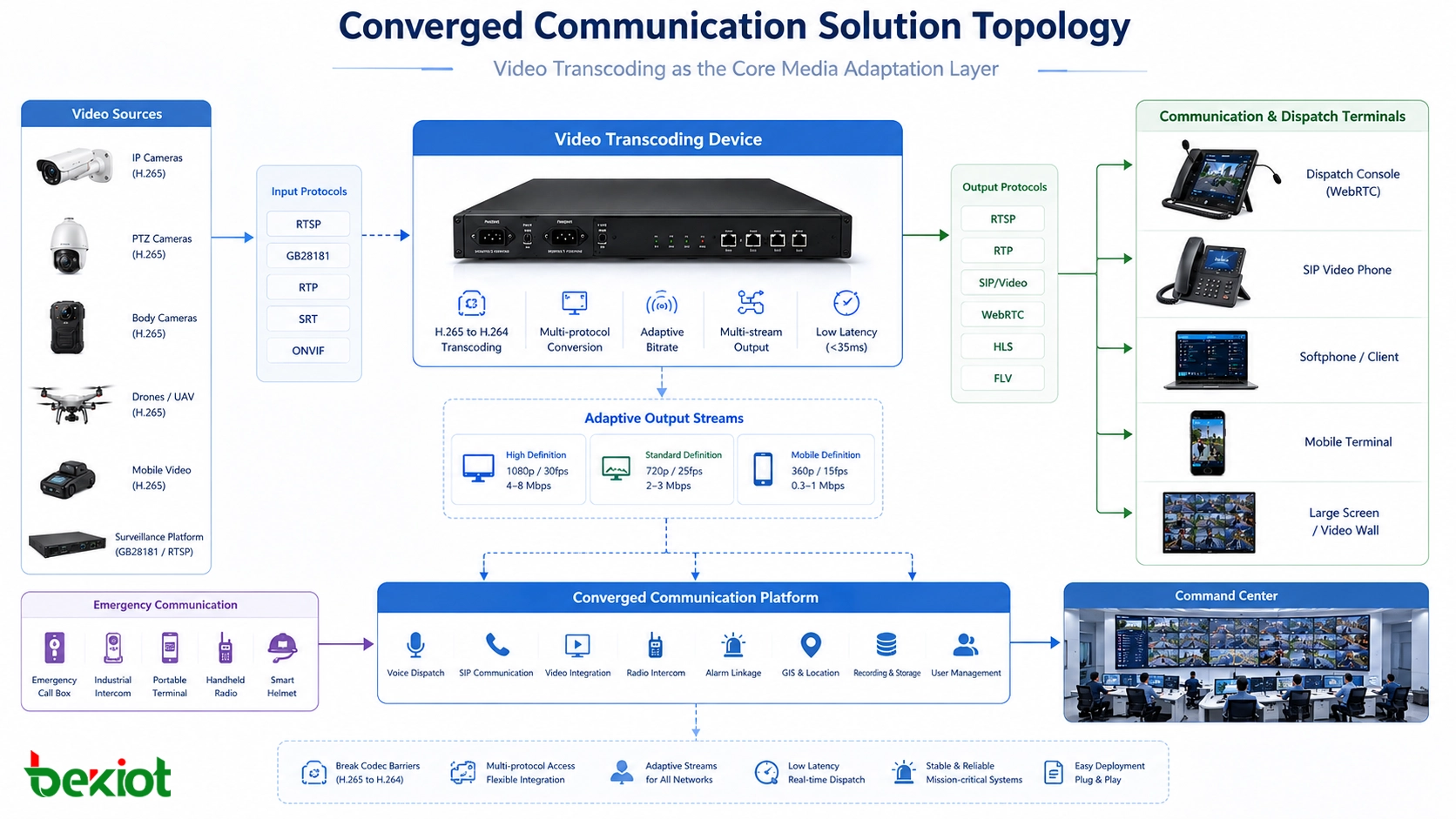

Muchos proyectos de comunicación convergente se diseñan alrededor de una plataforma de mando unificada con despacho de voz, videoconferencia, llamadas SIP, interconexión de radio, alarmas, GIS y video de vigilancia.

En el diagrama todo parece conectado, pero en la implantación real el acceso de video suele ser el punto donde aparecen los problemas de compatibilidad. Una cámara que funciona bien en un VMS no necesariamente puede ser consumida por una consola WebRTC o por un terminal de comunicación.

La cámara, la plataforma, el navegador, el terminal y el servidor multimedia pueden usar formatos y métodos de decodificación distintos. Por eso la capa de video debe planificarse como parte de la arquitectura central, no dejarse para el final.

La causa principal está en la codificación de video

En los últimos años, los sistemas de videovigilancia han migrado ampliamente hacia H.265. Es una decisión técnica razonable porque, con calidad similar, H.265 puede reducir el bitrate casi a la mitad frente a H.264.

En redes urbanas, parques industriales, transporte, energía y seguridad pública, ese ahorro reduce carga de red, amplía el tiempo de almacenamiento y mejora el uso de servidores y discos.

Pero las plataformas de comunicación convergente viven en otro entorno. Muchas consolas y clientes de navegador dependen de WebRTC, y el soporte de H.265 en navegadores principales sigue siendo incompleto.

Por qué WebRTC no puede decodificar cualquier flujo de cámara

WebRTC se usa mucho porque permite audio y video en tiempo real desde navegadores y clientes de software. Es ideal para consolas de despacho, videollamadas, colaboración remota y centros de mando.

Sin embargo, WebRTC no resuelve automáticamente todos los formatos. Muchas cámaras entregan H.265, mientras que muchos entornos WebRTC dependen de H.264 u otros formatos compatibles con el navegador.

El mismo problema aparece en terminales. Muchos teléfonos IP, consolas, clientes de software y equipos de campo no tienen decodificación H.265 fuerte por hardware, por lo que pueden fallar aunque la plataforma reciba el flujo.

En un proyecto convergente, la pregunta no es solo si el flujo existe, sino si cada terminal puede decodificarlo, mostrarlo y usarlo en tiempo real.

Los servidores multimedia no siempre están hechos para conversión en tiempo real

Muchas plataformas de comunicación usan marcos SIP y multimedia maduros, muy fuertes en voz, señalización, conferencias y control de llamadas.

La transcodificación de video es mucho más pesada que reenviar audio o controlar señalización. En muchas arquitecturas el servidor multimedia trata el video como paso directo y no como conversión intensiva en tiempo real.

Resolver transcodificación masiva dentro del servidor central puede aumentar la complejidad y afectar la estabilidad. Un dispositivo dedicado asume esa carga antes de que el flujo llegue a la plataforma o al terminal.

Una capa dedicada de conversión se vuelve necesaria

En proyectos con acceso a vigilancia, el transcodificador debe tratarse como infraestructura necesaria. Su función central es traducir formatos entre la red de video y la red de comunicación.

Convierte flujos H.265 de cámaras, fuentes móviles, grabadores, puntos temporales o plataformas existentes a H.264 u otros formatos que la plataforma y los terminales puedan usar.

El rendimiento en tiempo real es crítico. En mando y despacho, el video no puede quedar muy detrás de las instrucciones de voz; la latencia debe mantenerse lo bastante baja para apoyar decisiones operativas.

Los flujos adaptativos importan para distintos terminales

La conversión de códec es solo una parte. En un proyecto real los terminales son muy variados: pantallas de mando HD en LAN gigabit, terminales portátiles por 4G y clientes de software con capacidades diferentes.

Por eso el dispositivo debe ajustar resolución, frame rate y bitrate. Una misma fuente puede necesitar varios perfiles de salida para que cada terminal reciba la versión adecuada.

Si se envía un único flujo de alto bitrate a todos, los usuarios con poco ancho de banda sufrirán congelamientos, retrasos o fallos. La transcodificación adaptativa mejora la estabilidad del sistema completo.

La fragmentación de protocolos crea otra barrera

El ecosistema de comunicación convergente está fragmentado. Un proyecto puede incluir SIP, GB/T 28181, RTP, RTSP, FLV, HLS, WebRTC y otros protocolos de medios o señalización.

Cada protocolo puede pertenecer a plataformas, dispositivos, fabricantes o escenarios distintos. Por eso el equipo no debe limitarse a convertir H.265 a H.264.

Debe ofrecer entradas y salidas flexibles para que cámaras, plataformas de vigilancia, clientes de navegador, móviles y sistemas de comunicación se integren con menos desarrollo a medida.

Cómo se ve una arquitectura práctica

Una arquitectura práctica coloca el dispositivo de transcodificación entre el lado de videovigilancia y el lado de la plataforma de comunicación.

En la entrada recibe flujos de cámaras, plataformas GB/T 28181, fuentes RTSP u otros sistemas; en la salida entrega video útil para consolas WebRTC, terminales SIP, navegadores, pantallas de mando y clientes de software.

Así la plataforma de despacho se concentra en flujos de mando, usuarios, llamadas, alarmas y lógica de coordinación, mientras la capa de transcodificación gestiona conversión, adaptación y acceso de protocolos. Becke Telcom puede integrarlo dentro de soluciones de comunicación convergente.

Riesgos de ingeniería cuando se ignora la transcodificación

Los transcodificadores suelen subestimarse porque son menos visibles que consolas, servidores de grabación, videowalls o terminales. Algunos equipos suponen que si la cámara entrega un flujo, la plataforma podrá usarlo.

En la entrega real aparecen incompatibilidades de códec, fallos de reproducción en navegador, límites de decodificación, bitrate excesivo, protocolos no soportados o reenvío inestable.

Estos problemas afectan directamente la eficiencia de mando. En aceptación, el usuario se fija en apertura rápida, claridad, latencia aceptable y visualización en varios terminales.

Factores de selección para el diseño del proyecto

Primero se deben confirmar las fuentes de entrada: códec de cámara, protocolo, resolución, frame rate, bitrate y método de acceso. H.265 merece atención especial porque es común en vigilancia moderna pero no siempre compatible con terminales de comunicación.

Después se deben confirmar las salidas: H.264, flujos compatibles con WebRTC, HLS para navegador, RTSP para sistemas internos u otros formatos. También conviene prever múltiples perfiles de salida.

La tercera prueba es el comportamiento real. En despacho pesan más la baja latencia, la decodificación estable, el cambio fluido y el acceso multilateral que una lista teórica de protocolos.

| Área de diseño | Requisito clave | Valor del proyecto |

|---|---|---|

| Conversión de códec | Convertir H.265 a H.264 u otros formatos | Permite usar vigilancia con WebRTC y terminales |

| Baja latencia | Mantener una demora adecuada para despacho | Evita que el video se retrase frente a decisiones |

| Salida adaptativa | Ajustar resolución, frame rate y bitrate | Mejora acceso en LAN, 4G y redes mixtas |

| Compatibilidad de protocolos | Soportar SIP, GB/T 28181, RTP, RTSP, FLV, HLS y WebRTC | Reduce dificultad de integración |

| Integración de sistema | Trabajar con despacho, video, navegadores y terminales | Convierte el video en parte fiable del mando |

Dónde esta capa aporta más valor

La transcodificación es valiosa cuando el video de vigilancia debe entrar en un entorno de comunicación o despacho: centros de emergencia, seguridad pública, bomberos, salas industriales, transporte, parques inteligentes, energía, puertos, minas, campus y grandes propiedades.

En emergencias ayuda a comprender el sitio antes de decidir. En industria apoya inspección remota, confirmación de fallas y seguridad. En transporte coordina estaciones, túneles, hubs y mantenimiento.

La exigencia común es que el video sea utilizable dentro del flujo de comunicación, no que quede aislado en una plataforma de vigilancia.

Conclusión

Un proyecto real de comunicación convergente no puede depender solo de despacho de voz, señalización SIP e integración de plataforma. Si existe acceso a videovigilancia, la transcodificación debe formar parte de la arquitectura.

Un dispositivo dedicado convierte códecs, adapta bitrate, ajusta frame rate y resolución, y enlaza protocolos como SIP, GB/T 28181, RTP, RTSP, FLV, HLS y WebRTC.

Para ingenieros e integradores, la idea es clara: la transcodificación de video no es un adorno, sino la base que permite que la vigilancia sea una parte práctica, en tiempo real y confiable de la comunicación convergente.

FAQ

¿Por qué los proyectos convergentes necesitan transcodificación de video?

Porque muchas cámaras entregan H.265 y muchas consolas WebRTC, navegadores, teléfonos IP y terminales no lo decodifican de forma fiable. La transcodificación convierte el video a formatos utilizables.

¿H.265 es mejor que H.264?

H.265 es más eficiente para almacenamiento y ancho de banda, pero H.264 sigue siendo más compatible con muchos terminales y navegadores, por eso la conversión suele ser necesaria.

¿La plataforma de comunicación puede hacerlo sola?

No siempre. Muchas plataformas son fuertes en SIP, voz y conferencias, pero la transcodificación de video en tiempo real consume muchos recursos; un dispositivo dedicado suele ser más práctico.

¿Qué protocolos debe soportar un transcodificador?

Debe cubrir protocolos comunes como SIP, GB/T 28181, RTP, RTSP, FLV, HLS, WebRTC y los flujos de acceso requeridos por cámaras, plataformas y terminales.

¿Qué pasa si se ignora la transcodificación?

Pueden aparecer pantallas negras, flujos no soportados, alta latencia, video borroso, reproducción inestable o problemas de compatibilidad detectados tarde en pruebas o aceptación.