AI-RAN se está convirtiendo en uno de los temas más debatidos de la industria de las telecomunicaciones. Algunas personas lo consideran la siguiente etapa de la evolución de las redes inalámbricas, mientras que otras creen que podría estar sobrevalorado antes de que se verifiquen por completo el modelo de negocio, la estructura de costes y la arquitectura técnica. Para entender AI-RAN con claridad, es necesario ir más allá del término de marketing y analizar cómo convergen las redes de acceso radio, la computación de IA, la arquitectura de chips, el edge computing y la estrategia 6G.

AI-RAN significa Artificial Intelligence Radio Access Network. En términos sencillos, consiste en aplicar tecnologías de IA a la red de acceso radio o en construir una red inalámbrica capaz de procesar cargas de comunicación y cargas de IA de forma más integrada. No se trata solo de colocar software de IA en una estación base. El concepto más profundo es transformar la estación base de un nodo dedicado únicamente a la comunicación en un nodo inteligente de computación de borde.

Este artículo explica AI-RAN desde una perspectiva de solución e ingeniería. Cubre la evolución desde RAN tradicional hasta Open RAN, el papel de CPU, GPU, FPGA y ASIC, el significado de AI for RAN, AI and RAN y AI on RAN, el progreso industrial liderado por empresas como NVIDIA, SoftBank, Nokia, Ericsson, Huawei y ZTE, y los principales retos de despliegue que los operadores deben considerar.

Entender RAN antes de entender AI-RAN

RAN significa Radio Access Network. En una red móvil hay tres grandes partes: la red central, la red de transporte y la red de acceso radio. RAN es la primera capa que conecta dispositivos de usuario como smartphones, terminales industriales, sensores, vehículos y dispositivos IoT con la red del operador.

En la era 4G, una estación base se construía habitualmente con antenas, unidades de radio remotas llamadas RRU, unidades de banda base llamadas BBU y los enlaces entre ellas. La antena y la unidad de radio transmitían y recibían señales inalámbricas, mientras que la BBU realizaba tareas de banda base como modulación, demodulación, codificación, decodificación, estimación de canal y planificación de recursos.

En la era 5G, la arquitectura cambió. La antena y la RRU se integraron más y evolucionaron hacia la AAU, o Active Antenna Unit. Al mismo tiempo, las funciones de BBU se separaron en CU y DU. La CU, o Centralized Unit, gestiona principalmente funciones no en tiempo real. La DU, o Distributed Unit, gestiona principalmente procesamiento de banda base en tiempo real. Esta división hizo la red más flexible, pero también más compleja.

Por qué RAN es difícil de abrir y virtualizar

La red central fue más fácil de virtualizar porque muchas de sus tareas están relacionadas con enrutamiento, conmutación, control de sesiones y gestión de servicios. Esto impulsó el auge de NFV, o Network Functions Virtualization. RAN es mucho más difícil. El procesamiento de banda base exige baja latencia, alta densidad de cálculo, precisión temporal y rendimiento en tiempo real.

Las estaciones base tradicionales solían ser sistemas cerrados construidos por proveedores de equipos de telecomunicaciones. Usaban chips ASIC personalizados y software propietario. Este modelo de “caja negra” era eficiente porque los ASIC están diseñados para cargas fijas. Para el procesamiento de banda base RAN, los ASIC ofrecen alta densidad de cálculo, bajo consumo y latencia estable.

Posteriormente, los operadores impulsaron arquitecturas más abiertas y de tipo white-box. El objetivo era desacoplar hardware y software, estandarizar interfaces y permitir que servidores y chips de propósito general soportaran cargas de telecomunicaciones. Esta dirección generó C-RAN, O-RAN, vRAN, xRAN y Open RAN.

De C-RAN a Open RAN

En la era 4G, China Mobile promovió C-RAN, o Centralized RAN. La idea era trasladar múltiples BBU distribuidas a una sala centralizada y construir un pool de banda base. Ese pool procesa las cargas de banda base de forma centralizada y distribuye señales a las unidades de radio remotas mediante enlaces de fibra.

Open RAN fue más allá. Su idea clave es una arquitectura modular con interfaces estandarizadas. RU, DU y CU pueden proceder de distintos proveedores si las interfaces son compatibles. El software de banda base también puede separarse de chips dedicados y ejecutarse en plataformas de propósito general como servidores x86 o ARM.

Sin embargo, Open RAN también expuso un problema de ingeniería importante. Las plataformas CPU generales son flexibles, pero pueden consumir más energía, ofrecer menor eficiencia y mostrar latencias menos estables que los sistemas basados en ASIC dedicados. Por eso muchos despliegues Open RAN han tenido dificultades en operación comercial a gran escala. RAN no es solo un problema de software; también es un problema de computación en tiempo real y eficiencia energética.

Por qué la GPU entra en la conversación de RAN

La lógica de AI-RAN comienza con la arquitectura de chips. En sistemas de telecomunicaciones y computación, los principales chips lógicos incluyen CPU, GPU, FPGA y ASIC. La CPU representa computación general y suele asociarse con Open RAN. El ASIC representa equipos de telecomunicaciones especializados. El FPGA aporta flexibilidad y se usa en prototipos o despliegues especializados. La GPU es la nueva fuerza clave detrás de AI-RAN.

La estrategia AI-RAN de NVIDIA se basa en llevar la computación GPU a los sistemas de estación base. El objetivo no es solo usar GPU para procesamiento de banda base, sino también ejecutar modelos de IA cerca del borde de red. Si una estación base puede procesar cargas RAN y cargas de IA, puede convertirse en una nueva infraestructura de IA de borde.

Esto es importante porque la compra de equipos de telecomunicaciones es un mercado enorme, con gasto global anual superior a 100 mil millones de USD. Si las GPU pasan a formar parte de la arquitectura de estaciones base, la red de telecomunicaciones podría convertirse en un gran nuevo mercado de computación.

AI-RAN es más que una estación base con GPU

La idea central de AI-RAN no es simplemente “instalar GPU en estaciones base”. La idea estratégica es convertir la estación base en un servidor de IA de borde de baja latencia con conectividad 5G y futura 6G. En este modelo, la estación base procesa señales inalámbricas y ejecuta inferencia de IA para usuarios, dispositivos, vehículos, cámaras, robots y sistemas industriales cercanos.

La IA también puede mejorar la propia RAN. Con algoritmos de IA y aceleración GPU, la red puede realizar predicción más inteligente del estado del canal, identificación dinámica de interferencia multiusuario, optimización de haces milimétricos, predicción de tráfico, control de ahorro energético y planificación de recursos radio. Estas capacidades pueden mejorar el rendimiento y reducir la complejidad operativa.

Desde la perspectiva del edge computing, AI-RAN está entre la nube y el dispositivo. Los centros de datos cloud tienen la mayor potencia, pero están lejos de los usuarios y pueden generar más latencia. Los smartphones y terminales IoT están cerca, pero tienen potencia limitada. Las estaciones base están en medio: más cerca que la nube y más potentes que la mayoría de terminales, por lo que son una ubicación natural para IA de baja latencia.

Las tres direcciones técnicas de AI-RAN

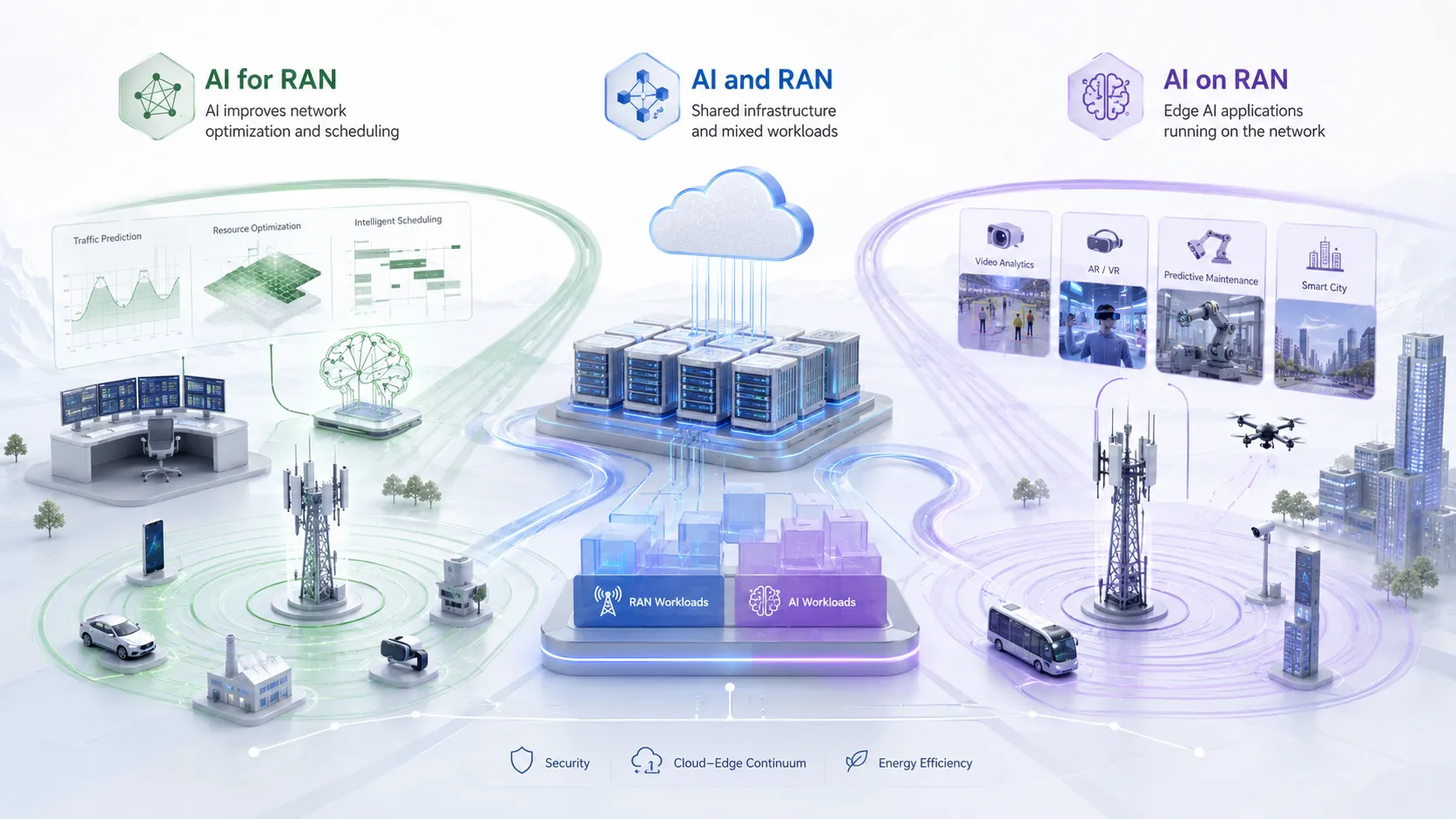

La AI-RAN Alliance divide la investigación en tres direcciones: AI for RAN, AI and RAN y AI on RAN. Son diferentes, pero están conectadas.

AI for RAN

AI for RAN significa usar IA para mejorar la red de acceso radio. El objetivo es hacer la red más eficiente, inteligente y fácil de operar. Los casos típicos incluyen predicción de tráfico, planificación inteligente, optimización energética, detección de fallos, gestión de interferencias y optimización de beamforming.

Es la dirección más directa y práctica porque mejora la propia red de telecomunicaciones. A los operadores les interesa porque puede mejorar el rendimiento y reducir costes operativos.

AI and RAN

AI and RAN significa ejecutar funciones de comunicación y funciones de IA en la misma infraestructura. En este modelo, las cargas RAN y las cargas de IA comparten recursos de cómputo. El reto técnico es aislar, programar, priorizar y equilibrar ambas sin afectar el rendimiento de comunicación en tiempo real.

Esta dirección es importante porque decide si AI-RAN puede convertirse en una plataforma rentable. Si el mismo hardware soporta comunicación de red y servicios de IA, los operadores pueden aumentar la utilización de recursos.

AI on RAN

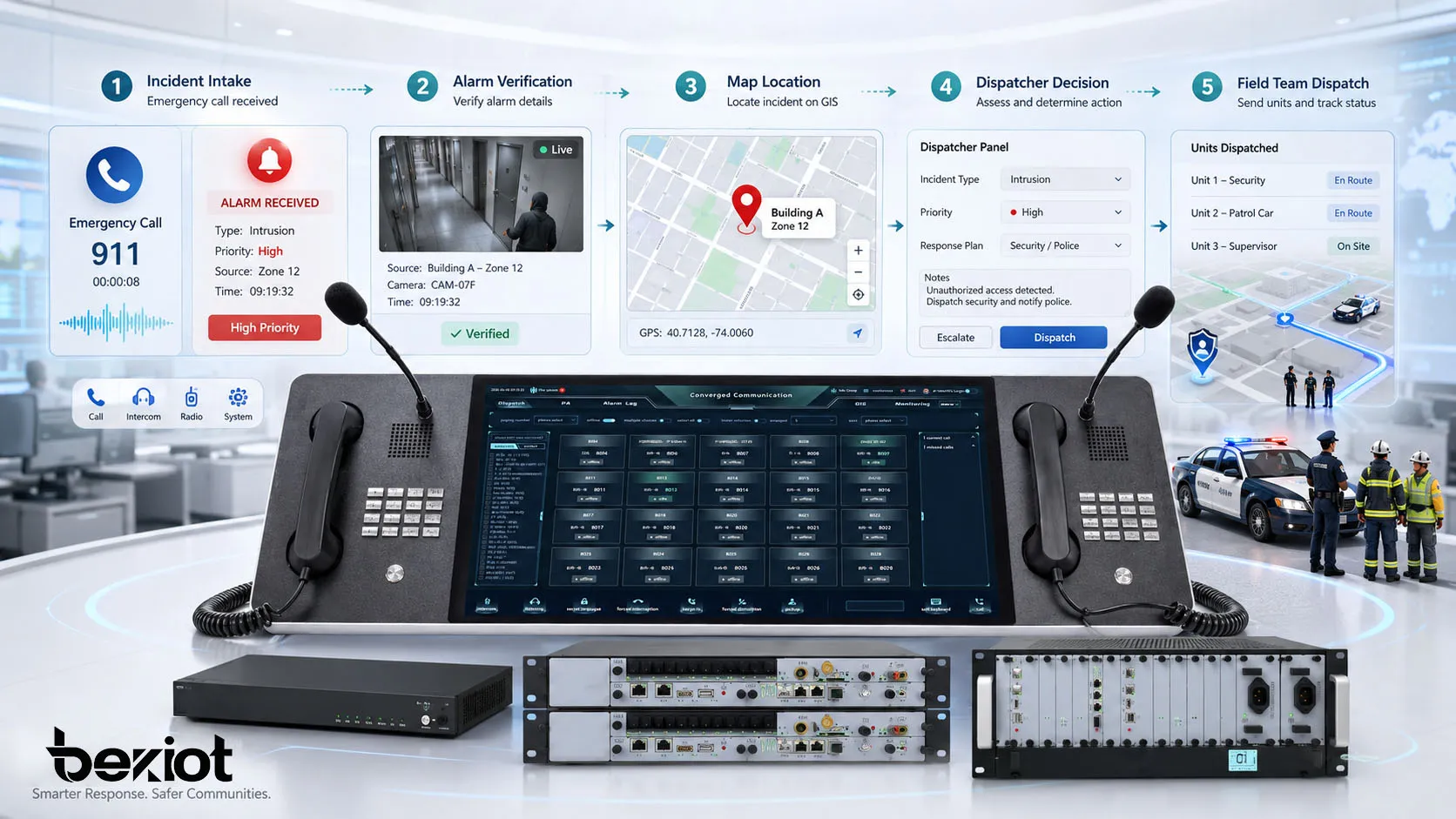

AI on RAN significa usar la infraestructura RAN para soportar aplicaciones externas de IA. Es la dirección más imaginativa. La estación base deja de ser solo un nodo de comunicación y se convierte en un nodo de inteligencia de borde programable para videoanalítica, posicionamiento industrial, sistemas autónomos, ciudades inteligentes, vehículos conectados, AR/VR y servicios de IA de baja latencia.

Aquí AI-RAN se conecta más estrechamente con 6G. Las redes futuras no solo transmitirán datos; también podrán percibir, calcular, analizar y coordinar servicios inteligentes en el borde.

Progreso industrial de AI-RAN

AI-RAN pasó del concepto a la acción industrial muy rápido. En febrero de 2024, durante el Mobile World Congress de Barcelona, NVIDIA, SoftBank, Ericsson, Nokia, Microsoft y otros miembros fundadores lanzaron la AI-RAN Alliance. La alianza comenzó con 11 fundadores y pronto creció a más de 100 operadores, proveedores y socios del ecosistema.

En noviembre de 2024, NVIDIA y SoftBank anunciaron una prueba de lo que describieron como la primera red AI-RAN del mundo capaz de procesar cargas de IA y 5G. En 2025, NVIDIA invirtió 1 mil millón de USD en Nokia, convirtiéndose en uno de sus mayores accionistas y reforzando la cooperación en soluciones 6G RAN y AI-RAN.

NVIDIA también siguió construyendo una solución AI-RAN de pila completa. En 2025 presentó Aerial RAN Computer Pro, también llamado ARC-Pro, y la plataforma de software AI Aerial. La solución integra GB200, BlueField-3, redes Spectrum-X y bibliotecas CUDA-X para casos de telecomunicaciones.

Más tarde, NVIDIA y socios promovieron el stack “All-American AI-RAN”, diseñado para asignar dinámicamente recursos dentro o entre GPU para vRAN, aplicaciones de IA e investigación 6G. En marzo de 2026, NVIDIA presentó la visión AI Grid en GTC. En esa visión, AI-RAN actúa como capa clave de red y cómputo de borde, mientras AI Grid aporta nube distribuida y orquestación.

Dos caminos industriales: unirse o construir de forma independiente

La industria de telecomunicaciones está formando dos respuestas generales. La primera es adoptar plenamente la arquitectura AI-RAN basada en GPU. Operadores como SoftBank y AT&T se interesan por inteligencia de red, reducción de OPEX, nuevos servicios y posicionamiento temprano para 6G. Algunas estimaciones sugieren que la automatización e inteligencia tipo AI-RAN podrían reducir el OPEX en más de 30% en ciertos escenarios.

Nokia es uno de los proveedores más visibles en este camino. Su software anyRAN puede integrarse con plataformas NVIDIA GPU AI RAN. En marzo de 2026, Nokia anunció pruebas de funciones AI-RAN con operadores como T-Mobile US, Telkom Indonesia y SoftBank.

El segundo camino es la exploración independiente. Muchos proveedores y operadores aceptan que la IA cambiará la arquitectura de comunicaciones, pero no quieren quedar bloqueados en un único ecosistema GPU. Ericsson, por ejemplo, ha probado software RAN en plataformas NVIDIA AI y a la vez integra un acelerador neuronal programable en sus chips Ericsson Silicon, acercando la inferencia de IA a equipos de radio como AAU y RRU.

Huawei y ZTE también exploran sus propias rutas de convergencia entre IA y telecomunicaciones. Huawei propuso una AI-Centric Network, mientras que ZTE presentó AIR MAX. Estas estrategias muestran que AI-RAN no es una solución de un solo proveedor, sino una dirección industrial amplia con múltiples rutas técnicas.

Por qué los operadores están interesados y preocupados

Los operadores se interesan por AI-RAN porque podría ayudarles a escapar del problema de la “tubería tonta”. Tradicionalmente venden conectividad, pero el valor de la conectividad pura está bajo presión. Si las estaciones base se convierten en nodos programables de IA de borde, los operadores podrían crear nuevos modelos de negocio basados en inferencia de baja latencia, aplicaciones industriales, exposición de datos, redes privadas y servicios de edge computing.

Algunos operadores también hablan de pasar de operar tráfico a operar “tokens”, o de ser proveedores de comunicación a ser proveedores de computación. AI-RAN encaja con ese objetivo porque combina conectividad radio y cómputo de IA de borde.

Pero también existen preocupaciones. Si el procesamiento de banda base y la inferencia de IA quedan ligados a una plataforma GPU concreta, el control de la arquitectura RAN puede desplazarse hacia ese ecosistema. Esto genera preocupaciones de bloqueo de proveedor, soberanía tecnológica, dependencia de cadena de suministro, transparencia de costes y poder de negociación a largo plazo.

Retos de despliegue de AI-RAN

AI-RAN enfrenta retos prácticos antes de un despliegue masivo. El primero es el coste. El CAPEX puede ser alto porque aceleradores de IA, servidores, equipos de red y upgrades de emplazamientos son caros. El OPEX también puede subir porque sistemas GPU consumen mucha electricidad y requieren nuevos procesos de refrigeración, mantenimiento y operación.

El segundo reto es el modelo de negocio. Los operadores deben responder cómo medir, valorar, vender y operar la computación de IA en el borde. ¿Debe venderse la capacidad AI-RAN como recursos cloud, slices de red, servicios industriales o una categoría totalmente nueva?

El tercer reto es la estandarización. Los estándares telecom suelen ser impulsados por 3GPP, mientras AI-RAN recibe fuerte impulso de la AI-RAN Alliance y socios del ecosistema. Aún no existe un marco unificado para semántica de datos, interfaces de modelos, orquestación de servicios, programación de cargas y responsabilidad comercial.

El cuarto reto es la madurez del ecosistema. Fabricantes de chips, proveedores de equipos, operadores, nubes, terminales, desarrolladores de aplicaciones y proveedores de modelos de IA deben decidir qué ruta técnica apoyar. Muchas empresas aún evalúan si invertir profundamente y cómo evitar apostar por la arquitectura equivocada.

Por qué la computación heterogénea puede ser la respuesta real

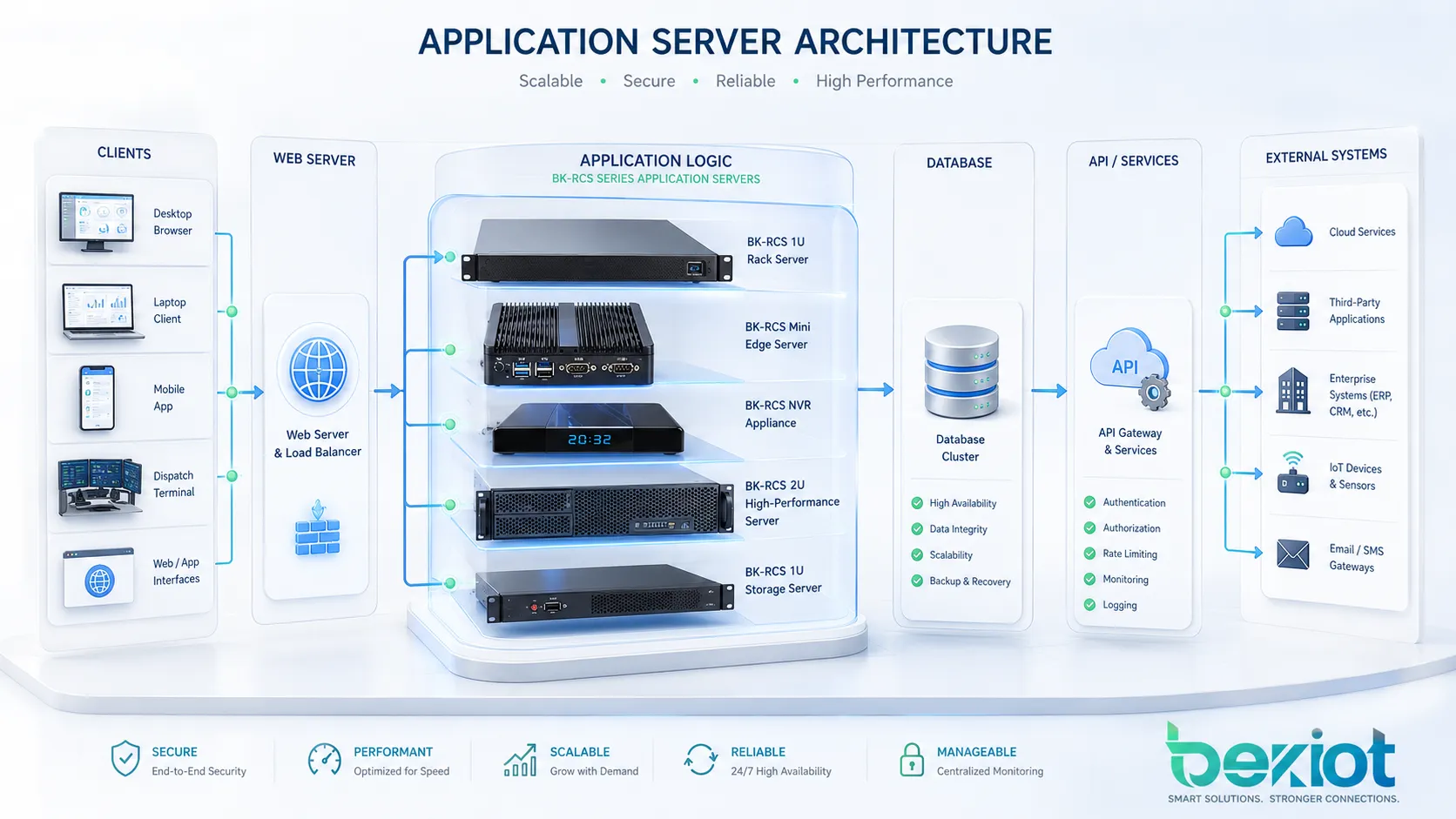

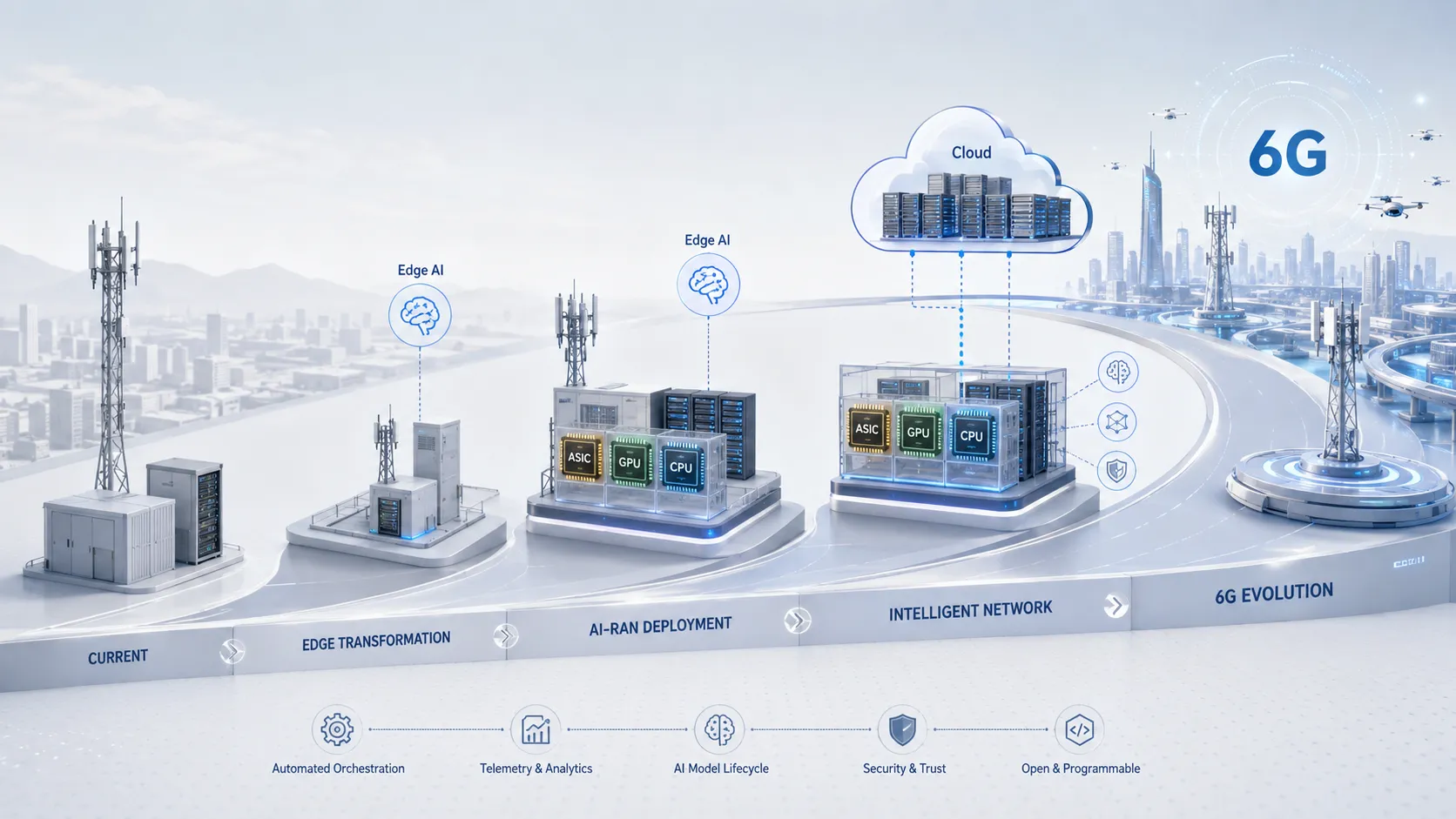

AI-RAN probablemente se desarrollará, pero la arquitectura final puede no ser puramente GPU. Una dirección más realista es la computación heterogénea, combinando ASIC + GPU + CPU y, en algunos escenarios, FPGA. Cada tipo de chip tiene su papel.

Los ASIC son eficientes para cargas telecom fijas. Las CPU ofrecen control general flexible y procesamiento de servicios. Las GPU son fuertes para IA paralela y ciertas cargas RAN aceleradas. Los FPGA aportan aceleración programable en escenarios especializados. Los operadores pueden mezclar recursos según rendimiento, eficiencia, coste, escala y ecosistema.

Esta arquitectura híbrida puede evitar la dependencia de una sola ruta tecnológica. También permite desplegar AI-RAN de forma gradual, empezando por optimización de red, videoanalítica de borde, posicionamiento industrial, redes privadas y plataformas de investigación 6G.

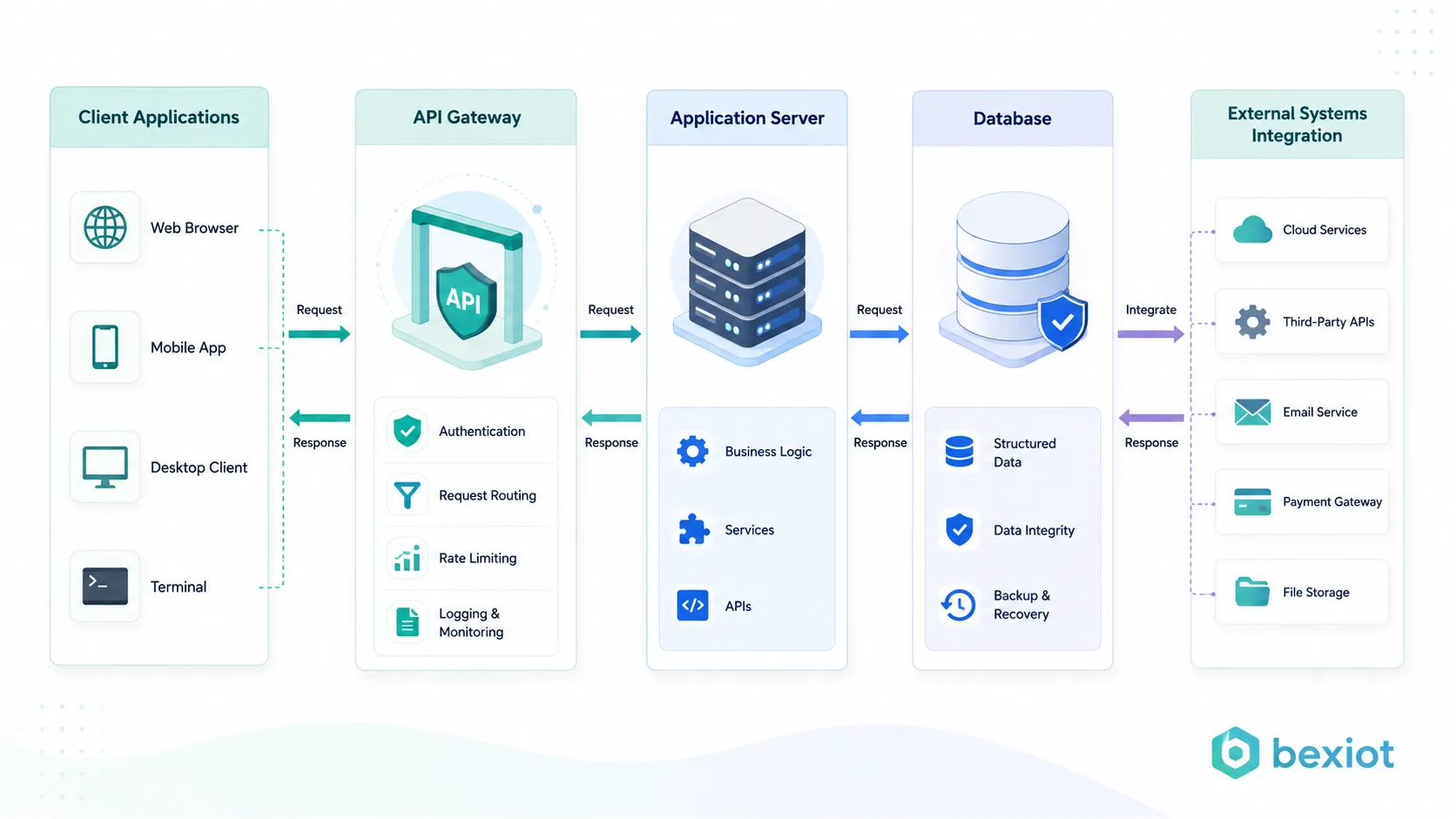

Arquitectura recomendada de solución AI-RAN

Una solución AI-RAN práctica debe diseñarse como arquitectura por capas, no como una simple actualización de hardware. La capa radio incluye RU, AAU, DU y CU. La capa de cómputo incluye ASIC, CPU, GPU y quizá FPGA. La capa de IA incluye runtime de modelos, motor de inferencia, procesamiento de datos y algoritmos de optimización. La capa de orquestación gestiona programación de cargas, exposición de servicios, monitoreo y ciclo de vida.

En esta arquitectura, las cargas telecom deben mantener siempre rendimiento determinista. Las cargas de IA pueden programarse según prioridad, capacidad disponible y latencia. Por ejemplo, el procesamiento RAN en tiempo real debe tener mayor prioridad que la inferencia no crítica. Aplicaciones industriales como videoanalítica, posicionamiento y control de baja latencia deben asignarse según SLA.

Los operadores también deben diseñar una capa de seguridad y gobernanza AI-RAN. Incluye privacidad de datos, seguridad de modelos, control de acceso, registros de auditoría, aislamiento de servicios y recuperación ante fallos. Como AI-RAN conecta infraestructura de red con aplicaciones de IA, sus requisitos de seguridad pueden ser más complejos que en una estación base tradicional.

Casos de uso de AI-RAN

Optimización de red

La IA puede predecir patrones de tráfico, identificar interferencias, optimizar recursos radio, mejorar el ahorro energético y apoyar el ajuste automático de la red. Esto pertenece principalmente a AI for RAN.

Videoanalítica en el borde

Una estación base con IA de borde puede procesar video cercano para seguridad pública, monitoreo industrial, gestión de tráfico y campus inteligentes. Esto reduce la necesidad de enviar todos los datos a una nube central.

Redes privadas industriales

En fábricas, puertos, minas, plantas energéticas y parques logísticos, AI-RAN puede combinar 5G privado con inferencia local. Puede apoyar visión artificial, control de robots, seguridad de trabajadores, inspección de equipos y monitoreo de producción de baja latencia.

Investigación 6G y redes nativas de IA

AI-RAN puede ser una base importante para 6G. Las futuras redes podrían integrar comunicación, sensado, computación e inteligencia. AI-RAN ofrece un posible camino hacia esa arquitectura nativa de IA.

Conclusión

AI-RAN es una de las direcciones tecnológicas más importantes en telecomunicaciones. Conecta evolución RAN, computación de IA, infraestructura de borde, Open RAN, aceleración GPU y estrategia 6G. Su objetivo no es solo mejorar estaciones base, sino transformar la red de acceso radio en una plataforma inteligente de edge computing.

Sin embargo, AI-RAN aún está en una etapa inicial. La industria avanzó rápidamente desde la creación de AI-RAN Alliance en 2024, pero el éxito comercial a gran escala todavía no está garantizado. CAPEX alto, OPEX alto, consumo eléctrico, bloqueo de proveedor, modelos de negocio inciertos, brechas de estandarización y ecosistemas inmaduros siguen siendo desafíos importantes.

El futuro más probable no será reemplazar RAN tradicional por AI-RAN basada en GPU de forma simple. Un camino más realista es la computación heterogénea, el despliegue por fases, interfaces abiertas, validación del modelo de negocio y evolución orientada a 6G. AI-RAN puede convertirse en tecnología central de la próxima revolución telecom, pero necesita tiempo, despliegues reales y prueba comercial.

FAQ

¿Qué significa AI-RAN?

AI-RAN significa Artificial Intelligence Radio Access Network. Se refiere a aplicar IA a la red de acceso radio e integrar cargas de comunicación inalámbrica con cargas de computación de IA.

¿AI-RAN consiste solo en poner GPU en estaciones base?

No. Las GPU son importantes en la discusión actual, pero AI-RAN es más amplio: incluye optimización de red con IA, infraestructura compartida para IA y RAN, y uso de RAN como plataforma de IA de borde.

¿Qué son AI for RAN, AI and RAN y AI on RAN?

AI for RAN usa IA para mejorar rendimiento y operación. AI and RAN ejecuta IA y comunicación en infraestructura compartida. AI on RAN usa la red RAN como plataforma de borde para aplicaciones de IA.

¿Por qué AI-RAN es importante para 6G?

Se espera que 6G integre comunicación, sensado, computación e inteligencia. AI-RAN puede aportar la base de edge computing y red nativa de IA necesaria para esa evolución.

¿Cuáles son los mayores desafíos de AI-RAN?

Incluyen CAPEX y OPEX altos, consumo energético, riesgo de bloqueo de proveedor, modelos de negocio inciertos, falta de estándares unificados y ecosistema aún inmaduro.

¿Qué arquitectura de cómputo es más probable para AI-RAN?

Probablemente una arquitectura heterogénea. Los operadores pueden combinar ASIC, GPU, CPU y a veces FPGA para equilibrar rendimiento, eficiencia, coste, flexibilidad y control del ecosistema.